开篇引入

在人工智能重塑各行各业的浪潮中,围棋AI技术始终占据着独特的标杆地位。作为衡量算法智能水平的重要试金石,围棋AI不仅代表了强化学习与蒙特卡洛树的巅峰融合,更是深度学习在现实复杂博弈中的首次大规模成功应用。然而许多开发者在使用围棋助手AI工具时,往往陷入“会用但不懂原理、调用API却说不清底层逻辑”的困境,面对面试官的追问更是一筹莫展。本文将从零开始,系统拆解围棋AI的核心技术架构,涵盖从概念梳理到代码实现、从底层原理到面试考点的完整链路,帮助读者真正吃透这门“AI皇冠上的明珠”。

一、痛点切入:为什么我们需要围棋助手AI?

在围棋AI普及之前,棋手的训练与复盘方式极为传统。先来看一段伪代码,模拟传统复盘分析的痛点:

传统复盘方式:纯人工分析 class TraditionalReview: def analyze_move(self, position, move): 缺乏数据支撑,完全依赖棋手经验 return "凭感觉判断这步棋的好坏" def find_improvement(self, game_record): 逐手人工翻阅,效率极低 for move in game_record: print(f"第{move.step}手需要人工复盘")

传统方式存在三大核心痛点:

效率低下:一盘棋的深度复盘需要数小时,依赖资深棋手或教练逐手分析,遗漏关键转折点的情况时有发生。

视角单一:受限于个人棋力水平和知识盲区,传统复盘难以发现隐藏的妙手或败招。

无法量化:缺乏客观的胜率评估和计算量指标,棋局判断全凭“感觉”,难以形成可追溯的数据化反馈。

正是为了解决这些痛点,围棋助手AI应运而生。它以算法之力提供客观、量化、多维度的棋局分析能力,让每一位棋手都能享受到接近职业水平的复盘服务。

二、核心概念讲解:蒙特卡洛树(MCTS)

蒙特卡洛树(Monte Carlo Tree Search,简称MCTS) 是一种结合了随机模拟方法与树结构的启发式算法,广泛应用于组合博弈中的行动规划-。

为了让这个概念更易理解,不妨做一个生活化类比:假设你是一位探险家,面前有一座巨大的迷宫,每条岔路都通向未知的终点。你没有地图,但可以反复派小分队去探索每条岔路。小分队走得越深,你收集的数据就越多,也就越清楚哪条路最可能通往出口——这就是MCTS的核心思想。在围棋中,MCTS通过模拟大量可能的棋局路径,不断“探索”和“利用”已有信息,最终选择胜率最高的落子点。

MCTS的价值在于它解决了围棋组合爆炸难题。围棋棋局复杂度高达10的170次方,远超宇宙原子总数,穷举根本不可行。而MCTS通过智能采样而非穷举,在有限的计算资源内逼近最优解,这正是围棋AI能够战胜人类冠军的关键技术基石。

三、关联概念讲解:深度神经网络(DNN)

深度神经网络(Deep Neural Network,简称DNN) 是一种由多层神经元组成的机器学习模型,能够从海量数据中自动提取特征并进行预测。

在围棋AI的语境下,MCTS和DNN的关系可以这样理解:MCTS是决策引擎,负责规划策略;而DNN则是感知大脑,负责快速评估局面优劣和直觉选点。具体到AlphaGo架构中,DNN承担两项关键任务:

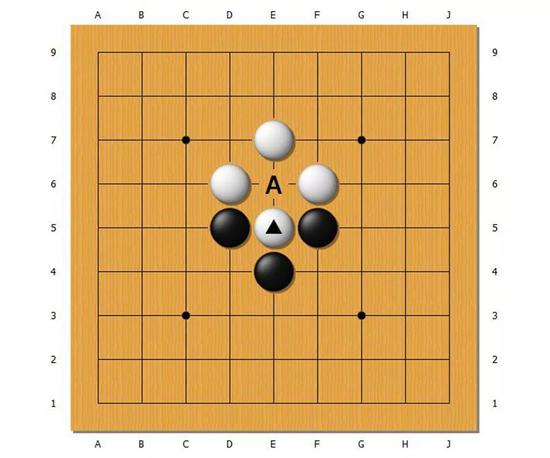

策略网络:学习高水平棋手的棋谱,获得“在当前局面下该如何落子”的直觉判断,快速缩小MCTS的范围。

价值网络:通过自我对弈的强化学习,掌握“当前局面谁占优”的形势判断能力。

两者的差异可以通过下表清晰对比:

| 维度 | MCTS | DNN |

|---|---|---|

| 角色定位 | 决策引擎(规划) | 感知大脑(直觉) |

| 工作机制 | 模拟推演、树 | 模式识别、特征提取 |

| 数据依赖 | 在线模拟生成 | 离线训练数据 |

| 计算特点 | 计算密集型 | 算力与模型复杂度正相关 |

一句话概括:MCTS是“深思熟虑”的战略家,DNN是“一眼看穿”的直觉大师。

四、概念关系与区别总结

MCTS与DNN在围棋AI中并非各自为战,而是深度耦合的“黄金搭档”:

关系定位:DNN为MCTS提供高质量的初始候选点和局面价值评估,大幅缩小空间;MCTS则用模拟结果反过来验证和修正DNN的判断,形成正向反馈循环。

分工逻辑:DNN负责“快思考”,快速筛选出少数几个有潜力的落子点;MCTS负责“慢思考”,对这些候选点进行深度推演和验证。

融合价值:二者的结合使围棋AI既拥有了人类的直觉判断力,又具备了超越人类的深度计算能力。

便于记忆的一句话:DNN缩小范围,MCTS锁定最佳答案。

五、代码/流程示例演示

以下是用KataGo引擎搭建围棋助手AI的完整示例,展示从引擎加载到实时棋局分析的完整流程:

基于KataGo引擎的围棋AI助手核心实现 import subprocess import json class GoAIAssistant: def __init__(self, engine_path="katago.exe", config_path="default.cfg"): 1. 初始化KataGo引擎 self.engine = subprocess.Popen( [engine_path, "gtp", "-config", config_path], stdin=subprocess.PIPE, stdout=subprocess.PIPE, text=True ) self.board_size = 19 def send_command(self, cmd): 2. 发送GTP协议命令 self.engine.stdin.write(cmd + "\n") self.engine.stdin.flush() return self.engine.stdout.readline().strip() def analyze_position(self, sgf_moves): 3. 分析棋局,获取AI评估 self.send_command(f"boardsize {self.board_size}") for move in sgf_moves: self.send_command(f"play {move.color} {move.coord}") 4. 请求AI推荐落子点及胜率 response = self.send_command("lz-analyze 10") 分析10个候选点 return self._parse_analysis(response) def get_winrate(self): 5. 获取当前局面胜率评估 score = self.send_command("lz-score") return float(score.split()[1]) 使用示例 ai = GoAIAssistant() winrate = ai.get_winrate() print(f"当前胜率: {winrate:.1f}%")

代码执行流程解析:

引擎初始化:通过GTP协议启动KataGo引擎进程,这是围棋AI的标准通信接口。

命令发送:通过

stdin/stdout管道与引擎交互,每条GTP命令对应一次AI操作。局面分析:将棋谱中的每一手棋依次“喂”给引擎,让AI建立完整的局面认知。

候选点推荐:调用

lz-analyze指令,让AI返回N个最优落子点及其胜率预测。胜率读取:通过

lz-score获取当前局面的即时胜率评估。

与传统人工复盘相比,AI辅助分析的优势显而易见:传统方式需要数小时逐手分析且依赖个人经验,而AI助手能在毫秒级内给出包含胜率、计算量、候选变化图在内的全方位数据化反馈,让复盘效率提升百倍以上。

六、底层原理/技术支撑点

围棋助手AI的底层技术支撑主要来自以下三个层面:

强化学习框架:AlphaGo及其后续版本采用的核心训练范式,通过自我对弈(Self-play)持续优化策略。AI无需人类棋谱即可自学成才,AlphaZero在数十小时的自我对弈后,便击败了此前所有最先进的围棋AI程序-。

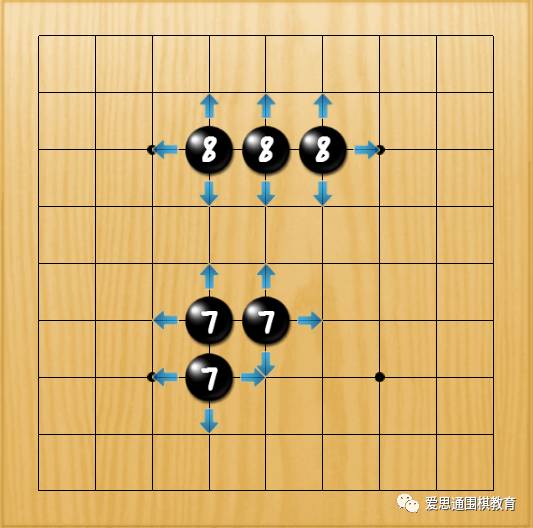

蒙特卡洛树(MCTS)的四个阶段:标准MCTS流程包含选择、扩展、评估、备份四个步骤-。选择阶段依据UCT公式在树中选择最有潜力的分支;扩展阶段在叶节点添加新的局面节点;评估阶段借助价值网络判断局面优劣;备份阶段将评估结果沿路径回传更新父节点统计信息。

并行计算架构:现代围棋AI依赖GPU集群进行并行计算,AlphaGo使用超过1000个CPU和GPU进行并行学习和-。模型推理阶段利用GPU的矩阵运算加速神经网络前向传播,训练阶段则利用分布式架构完成海量自我对弈数据的收集与模型更新。

这四个层次的技术栈由底层到上层构成了围棋AI的完整技术体系,后续进阶内容将逐一深入探讨。

七、高频面试题与参考答案

Q1:请解释蒙特卡洛树(MCTS)的核心思想,并说明它在围棋AI中的作用。

参考答案:MCTS的核心思想是通过随机模拟来评估决策路径的优劣,包含选择、扩展、评估、备份四个阶段。在围棋AI中,MCTS解决了组合爆炸问题——在10的170次方量级的棋局空间中,通过智能采样而非穷举,在有限计算资源内逼近最优解。它与深度神经网络配合,用价值网络指导方向,用策略网络缩小范围,从而在实战中达到超人类水平。

Q2:策略网络和价值网络有什么区别?为什么两者都需要?

参考答案:策略网络负责预测下一步棋的落子概率分布,回答“哪里该下”;价值网络负责评估当前局面的胜负概率,回答“谁占优”。两者都需要是因为围棋的复杂性:仅有策略网络会缺乏深度评估能力,仅有价值网络则无法高效缩小空间。两者结合可实现“快思考+慢思考”的双系统决策,这也是AlphaGo的核心创新。

Q3:围棋AI如何实现从入门水平到职业水平的棋力跃升?

参考答案:主要依赖三个阶段的训练策略:第一阶段是模仿学习,用数十万人类棋谱训练策略网络,获得基础棋感;第二阶段是强化学习,让AI与自己对弈数百万盘,通过胜负反馈持续优化策略网络和价值网络;第三阶段是MCTS增强,在实战中结合神经网络引导的树,让AI在有限思考时间内做出最优决策。这套训练范式已成为现代游戏AI的标准模板。

Q4:GTP协议是什么?在围棋AI开发中扮演什么角色?

参考答案:GTP(Go Text Protocol)是围棋AI引擎与前端的标准通信协议。它定义了一套文本命令格式(如genmove、lz-analyze),使得前端界面可以统一调用不同引擎(KataGo、LeelaZero等)。GTP的关键价值在于解耦——引擎开发者只需实现GTP接口,前端开发者无需关心引擎内部实现,两者可独立迭代,极大降低了围棋AI工具链的开发成本。

八、结尾总结

回顾全文,我们系统梳理了围棋助手AI的核心知识链路:

✅ 痛点认知:传统复盘效率低、视角单一、缺乏量化——这正是AI介入的刚需场景。

✅ 核心概念:MCTS解决组合爆炸,DNN提供直觉判断,二者深度耦合。

✅ 代码实践:通过KataGo引擎和GTP协议,开发者可在半小时内搭建可运行的围棋AI分析工具。

✅ 底层原理:强化学习自我对弈 + MCTS四阶段 + GPU并行计算,构成完整技术栈。

✅ 面试考点:MCTS流程、策略网络与价值网络的区别、GTP协议作用等,是高频考察内容。

重点与易错提示:切勿混淆MCTS与DNN的职责分工——前者是算法,后者是机器学习模型,二者配合而非替代。同时要理解,围棋AI的强大并非来自单一技术的突破,而是MCTS、深度神经网络、强化学习、并行计算等多技术协同发力的结果。

下一篇我们将深入MCTS的数学原理,详解UCT公式的推导逻辑与工程实现优化,敬请期待。

本文涉及的全部代码示例已托管至Git仓库,包含KataGo引擎配置模板及GTP协议完整封装,欢迎取用学习。

上海羊羽卓进出口贸易有限公司

上海羊羽卓进出口贸易有限公司